За цією вибіркою скласти варіаційний ряд. Приклад вирішення типових завдань

Словник статистичних термінів

Загальні питання статистики

ЩО ТАКЕ МЕДИЧНА СТАТИСТИКА?

Статистикою називають кількісний опис та вимір подій, явищ, предметів. Її розуміють як галузь практичної діяльності(збір, обробка та аналіз даних про масові явища), як галузь знання, тобто. спеціальну наукову дисципліну, і, як сукупність зведених, підсумкових цифрових показників, зібраних для характеристики будь-якої галузі суспільних явищ.

Статистика – наука, вивчає закономірності масових явищ шляхом узагальнюючих показників.

Медична статистика – самостійна суспільна наука, що вивчає кількісний бік масових суспільних явищу нерозривному зв'язку з їх якісною стороною, що дозволяє методом узагальнюючих показниківвивчити закономірності цих явищ, найважливіших процесів у економічному, соціальному житті суспільства, його здоров'я, системі організації медичної допомоги населенню.

Статистичні методи – це сукупність прийомів обробки матеріалів масових спостережень, до яких належать: угруповання, зведення, отримання показників, їхній статистичний аналіз тощо.

Статистичні методи в медицині використовуються для:

- вивчення стану громадського здоров'я населення в цілому та його основних груп шляхом збору та аналізу статистичних даних про чисельність та склад населення, його відтворення, фізичний розвиток, поширеності та тривалості різних захворювань тощо;

- виявлення та встановлення зв'язків загального рівня захворюваності та смертності від будь-яких окремих хвороб з різними факторами навколишнього середовища;

- збір та вивчення числових даних про мережу медичних установ, їх діяльність та кадри для планування медико-санітарних заходів, контролю за виконанням планів розвитку мережі та діяльності закладів охорони здоров'я та оцінки якості роботи окремих медичних установ;

- оцінка ефективності заходів щодо попередження та лікування захворювань;

- визначення статистичної значущості результатів дослідження у клініці та експерименті.

Розділи медичної статистики:

- загальнотеоретичні та методичні засади статистики,

- статистика здоров'я населення,

- статистика охорони здоров'я.

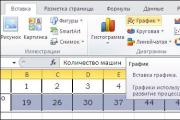

СТВОРЕННЯ БАЗИ ДАНИХ У MS EXCEL

Для того, щоб база даних була зручною для подальшої обробки, слід дотримуватися нехитрих принципів:

1) Оптимальною програмою створення бази даних є MS Excel. Дані з Excel у подальшому можуть без проблем переноситися в інші спеціалізовані статистичні пакети, такі як Statistica, SPSS та ін для більш складних маніпуляцій. Однак до 80-90% розрахунків можуть зручно проводитися в самій Excel з використанням надбудови "Аналіз даних".

2) Верхній рядок таблиці з базою даних оформляється як шапка, куди заносяться найменування тих показників, які враховуються у цьому стовпці. Небажано використовувати злиття осередків (ця вимога відноситься взагалі до всієї бази), так як при цьому багато операцій стануть неприпустимим. Також не варто створювати "двоповерхову" шапку, в якій верхній рядок позначає назву групи однорідних показників, а нижня – конкретні показники. Для угруповання однорідних показників краще відзначити їх одноколірною заливкою або включити до їх найменування групуючу ознаку в дужках.

Наприклад, не так:

| ЗАГАЛЬНИЙ АНАЛІЗ КРОВІ | ||

| ER | LEU | TR |

| ER(ОАК) | LEU(ОАК) | TR(ОАК) |

в останньому варіанті забезпечена і одноповерховість шапки, і наочна однорідність даних (всі вони відносяться до показників ОАК).

3) У першому стовпці слід розміщувати порядковий номер пацієнта в цій базі, не прив'язуючи його до жодного з досліджуваних показників. Це дозволить у подальшому забезпечити легкий відкат до початкового порядку пацієнтів будь-якому етапі, навіть після численних сортувань списку.

4) Другий стовпець зазвичай заповнюється прізвищами (або П.І.Б.) пацієнтів.

5) Кількісні показники (ті, що вимірюються числами, наприклад - зростання, вага, артеріальний тиск, ЧСС тощо) вписуються в таблицю у числовому форматі. Здавалося б це і так зрозуміло, проте слід пам'ятати, що в Excel, починаючи з 2007 версії, дробові величини позначаються через точку: 4.5. Якщо записати число через кому, воно буде сприйнято як текст, і ці стовпці доведеться переписувати.

6) З якісними показниками складніше. Ті з них, які мають два варіанти значення (так звані, бінарні величини: Так-Ні, Є-Відсутня, Чоловічий-Жіночий), краще переводити в двійкову систему: 0 і 1. Значення 1 зазвичай присвоюється позитивному значенню (Так, Є) 0 - негативному (Ні, Відсутня).

7) Якісні показники, що мають кілька значень, що відрізняються за ступенем вираженості, рівнем явища (Слабкий-Середній-Сильний; Холодний-Теплий-Гарячий) можуть бути ранжовані і, відповідно, також переведені до числа. Найменшому рівню явища надається найменший ранг - 0 або 1, наступні ступені позначаються значеннями рангів по порядку. Наприклад: Захворювання відсутнє - 0, легкого ступеня тяжкості -1, середнього ступеня - 2, тяжкого ступеня - 3.

8) Іноді одному якісному показнику відповідають кілька значень. Наприклад, у графі "Супутній діагноз" за наявності кількох захворювань ми хочемо вказати їх через кому. Робити так не слід, оскільки обробка таких даних дуже утруднена і не може бути автоматизована. Тому краще зробити кілька стовпців з конкретними групами захворювань ("захворювання ССС", "захворювання ШКТ" і т.д.) або певними нозологіями ("хр.гастрит", "ІХС" і т.д.), в які дані заносимо в бінарному, двійковому вигляді: 1 (що означає "Є дане захворювання") - 0 ("Немає даного захворювання").

9) Для розмежування окремих груп показників можна активно користуватися кольором: наприклад, стовпці з показниками ОАК виділяємо червоним кольором, дані ОАМ - жовтим і т.д.

10) Кожному пацієнту має відповідати один рядок таблиці.

Подібне оформлення бази даних дозволяє не лише значно спростити процес її статистичної обробки, а й полегшити її заповнення на етапі збирання матеріалу.

ЯКИЙ МЕТОД ВИБРАТИ ДЛЯ СТАТИСТИЧНОГО АНАЛІЗУ?

Після того, як зібрані всі дані, перед кожним дослідником постає питання вибору найбільш придатного способу статистичної обробки. І це не дивно: сучасна статистика поєднує величезну кількість різноманітних критеріїв та методів. Всі вони мають свої особливості, можуть підходити або не підходити для двох, здавалося б, схожих ситуацій. У цій статті ми постараємося систематизувати всі основні, найпоширеніші методи статистичного аналізуза їх призначенням.

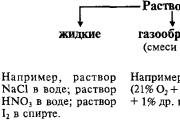

Проте спочатку кілька слів у тому, які бувають статистичні дані, оскільки саме від цього залежить вибір найбільш відповідного методу аналізу.

Шкала виміру

Під час проведення дослідження в кожної одиниці спостереження визначаються значення різних ознак. Залежно від того, за якою шкалою вони вимірюються, всі ознаки поділяються на кількісніі якісні. Якісні показники в дослідженнях розподіляються за так званою номінальноюшкалою. Крім того, показники можуть бути представлені по ранговийшкалою.

Наприклад, проводиться порівняння показників серцевої діяльності у спортсменів та осіб, які ведуть малорухливий спосіб життя.

При цьому у досліджуваних визначалися такі ознаки:

- підлога- є номінальнимпоказником, що приймає два значення - чоловічий чи жіночий.

- вік - кількіснийпоказник,

- заняття спортом - номінальнийпоказник, що приймає два значення: займається або не займається,

- частота серцевих скорочень - кількіснийпоказник,

- систолічний артеріальний тиск - кількіснийпоказник,

- наявність скарг на біль у грудній клітці- є якіснимпоказником, значення якого можуть бути визначені як за номінальною(є скарги - немає скарг), так і по ранговийшкалі залежно від частоти (наприклад, якщо біль виникає кілька разів на день – показнику присвоюється ранг 3, кілька разів на місяць – ранг 2, кілька разів на рік – ранг 1, за відсутності скарг на біль у грудній клітці – ставиться ранг 0) .

Кількість зіставних сукупностей

Наступне питання, яке необхідно вирішити для вибору статистичного методу, полягає в кількості сукупностей, які можна порівняти в рамках дослідження.

- У більшості випадків, у клінічних дослідженнях ми маємо справу з двома групами пацієнтів. Основнийі контрольної. Основний, або досвідченої, прийнято вважати групу, в якій був застосований метод діагностики або лікування, що вивчається, або в якій пацієнти страждають захворюванням, що є предметом даного дослідження. Контрольнугрупу, навпаки, складають пацієнти, які отримують звичайну медичну допомогу, плацебо, або особи, у яких відсутнє захворювання, що вивчається. Такі сукупності, представлені різними пацієнтами, називаються непов'язаними.

Ще бувають пов'язані, або парні, сукупності, коли йдеться про тих самих людей, але порівнюються значення якого-небудь ознаки, отримані до і післядослідження. Число порівнюваних сукупностей при цьому дорівнює 2, проте до них застосовуються інші методики, ніж до незв'язаних. - Іншим варіантом є опис однієїсукупності, що, слід визнати, взагалі є основою будь-якого дослідження. Навіть якщо основною метою роботи є порівняння двох чи більше груп, кожну їх необхідно попередньо охарактеризувати. Для цього використовуються методи описової статистики. Крім того, для однієї сукупності можуть застосовуватись методи кореляційного аналізу, що використовуються для знаходження зв'язку між двома або декількома ознаками, що вивчаються (наприклад, залежність росту від маси тіла або залежність частоти серцевих скорочень від температури тіла).

- Нарешті, порівнюваних сукупностей може бути кілька. Стосовно медичних досліджень це трапляється дуже часто. Пацієнти можуть бути згруповані залежно від застосування різних препаратів (наприклад, при порівнянні ефективності антигіпертензивних засобів: 1 група – інгібітори АПФ, 2 – бета-адреноблокатори, 3 – препарати центральної дії), за ступенем тяжкості захворювання (1 група – легкий ступінь, 2 - Середня, 3 - важка) і т.д.

Важливим також питання нормальності розподілудосліджуваних сукупностей. Від цього залежить, чи можна застосовувати методи параметричного аналізучи тільки непараметричного. Умовами, які повинні дотримуватись у нормально розподілених сукупностях, є:

- максимальна близькість або рівність значень середньої арифметичної, моди та медіани;

- дотримання правила "трьох сигм" (в інтервалі М±1σ знаходяться не менше 68,3% варіант, в інтервалі М±2σ - не менше 95,5% варіант, в інтервалі М±3σ знаходяться не менше 99,7% варіант;

- показники виміряні у кількісній шкалі;

- позитивні результати перевірки на нормальність розподілу за допомогою спеціальних критеріїв – Колмогорова-Смирнова чи Шапіро-Вилка.

Після визначення всіх зазначених нами ознак досліджуваних сукупностей пропонуємо скористатися наступною таблицею для вибору найбільш оптимального методу статистичного аналізу.

| Метод | Шкала вимірювання показників | Кількість порівнюваних сукупностей | Ціль обробки | Розподіл даних |

| t-критерій Стьюдента | кількісна | 2 | нормальне | |

| t-критерій Стьюдента з поправкою Бонфероні | кількісна | 3 і більше | порівняння непов'язаних сукупностей | нормальне |

| Парний t-критерій Стьюдента | кількісна | 2 | нормальне | |

| Однофакторний дисперсійний аналіз (ANOVA) | кількісна | 3 і більше | порівняння непов'язаних сукупностей | нормальне |

| Однофакторний дисперсійний аналіз (ANOVA) із повторними вимірами | кількісна | 3 і більше | порівняння пов'язаних сукупностей | нормальне |

| U-критерій Манна-Уітні | кількісна, рангова | 2 | порівняння непов'язаних сукупностей | будь-яке |

| Q-критерій Розенбауму | кількісна, рангова | 2 | порівняння непов'язаних сукупностей | будь-яке |

| Критерій Краскелла-Уолліса | кількісна | 3 і більше | порівняння непов'язаних сукупностей | будь-яке |

| Критерій Вілкоксона | кількісна, рангова | 2 | порівняння пов'язаних сукупностей | будь-яке |

| G-критерій знаків | кількісна, рангова | 2 | порівняння пов'язаних сукупностей | будь-яке |

| Критерій Фрідмана | кількісна, рангова | 3 і більше | порівняння пов'язаних сукупностей | будь-яке |

| Критерій χ 2 Пірсона | номінальна | 2 і більше | порівняння непов'язаних сукупностей | будь-яке |

| Точний критерій Фішера | номінальна | 2 | порівняння непов'язаних сукупностей | будь-яке |

| Тест Мак-Немара | номінальна | 2 | порівняння пов'язаних сукупностей | будь-яке |

| Q-критерій Кохрена | номінальна | 3 і більше | порівняння пов'язаних сукупностей | будь-яке |

| Відносний ризик (Risk Ratio, RR) | номінальна | 2 | порівняння непов'язаних сукупностей у когортних дослідженнях | будь-яке |

| Відношення шансів (Odds Ratio, OR) | номінальна | 2 | порівняння незв'язаних сукупностей у дослідженнях на кшталт «випадок-контроль» | будь-яке |

| Коефіцієнт кореляції Пірсона | кількісна | 2 ряди вимірів | нормальне | |

| Коефіцієнт рангової кореляції Спірмена | кількісна, рангова | 2 ряди вимірів | виявлення зв'язку між ознаками | будь-яке |

| Коефіцієнт кореляції Кендала | кількісна, рангова | 2 ряди вимірів | виявлення зв'язку між ознаками | будь-яке |

| Коефіцієнт конкордації Кендалл | кількісна, рангова | 3 і більше рядів вимірів | виявлення зв'язку між ознаками | будь-яке |

| Розрахунок середніх величин (M) та середніх помилок (m) | кількісна | 1 | описова статистика | будь-яке |

| Розрахунок медіан (Ме) та перцентилів (квартилів) | рангова | 1 | описова статистика | будь-яке |

| Розрахунок відносних величин (Р) та середніх помилок (m) | номінальна | 1 | описова статистика | будь-яке |

| Критерій Шапіро-Вілка | кількісна | 1 | аналіз розподілу | будь-яке |

| Критерій Колмогорова-Смирнова | кількісна | 1 | аналіз розподілу | будь-яке |

| Критерій ω 2 Смирнова-Крамера-фон Мізеса | кількісна | 1 | аналіз розподілу | будь-яке |

| Метод Каплана-Мейєра | будь-яка | 1 | аналіз виживання | будь-яке |

| Модель пропорційних ризиків Коксу | будь-яка | 1 | аналіз виживання | будь-яке |

Великі вчені-статистики

Карл Пірсон (27 березня 1857 – 27 квітня 1936)

27 березня 1857 року народився Карл Пірсон - великий англійський математик, статистик, біолог та філософ; засновник математичної статистики, один із основоположників біометрики.

Отримавши у віці 27 років посаду професора прикладної математики в лондонському Університетському коледжі, Карл Пірсон почав вивчати статистику, яку сприйняв як загальнонауковий інструмент, який відповідає його зовсім не загальноприйнятим думкам щодо необхідності забезпечити студентам широкий кругозір.

До основних заслуг Пірсона в галузі статистики можна віднести розробку основ теорії кореляції та сполученості ознак, введення “кривих Пірсона” для опису емпіричних розподілів та виключно важливого критерію хі-квадрат, а також складання великої кількості статистичних таблиць. Пірсон застосовував статистичний метод і особливо теорію кореляції у багатьох галузях науки.

Ось одне з його висловлювань: "Першому аматорському впровадженню сучасних статистичних методів у науку протистоїть типова зневага. Але я дожив до того часу, коли багато хто з них почали потай застосовувати ті самі методи, які вони спочатку засуджували ".

І вже в 1920 р. Пірсон склав записку, в якій заявив, що мета біометричної школи "перетворити статистику на галузь прикладної математики, узагальнити, відкинути або обґрунтувати убогі методи старої школи політичних і соціальних статистиків, і, загалом, перетворити статистику зі спортмайданчика для любителів та сперечальників у серйозну галузь науки. Необхідно було критикувати недосконалі та часто помилкові методи в медицині, антропології, краніометрії, психології, кримінології, біології, соціології, щоб забезпечити ці науки новими та потужнішими засобами. Битва тривала майже двадцять років, але з'явилося багато ознак того, що колишня ворожість залишилася позаду, а нові методи прийняті повсюдно.

Карл Пірсон відрізнявся дуже різнобічними інтересами: вивчав фізику в Гейдельберзі, цікавився соціальною та економічною роллю релігії і навіть читав лекції з німецької історії та літератури в Кембриджі та Лондоні.

Маловідомий той факт, що у віці 28 років, Карл Пірсон читав лекції про "жіноче питання" і навіть заснував Клуб чоловіків і жінок, що проіснував до 1889 р., в якому вільно і необмежено обговорювалося все, що стосується жінок, включаючи взаємини між статями.

Клуб складався з рівної кількості чоловіків та жінок, в основному, ліберальних представників середнього класу, соціалістів та феміністок.

Предметом дискусій клубу були питання найширшого спектру: від сексуальних відносину давньогрецьких Афінах до становища буддійських черниць, від ставлення до шлюбу до проблем проституції. По суті, «Клуб чоловіків і жінок» кидав виклик давно встановленим нормам взаємодії чоловіків та жінок, а також уявленням про «правильну» сексуальність. В епоху вікторіанської Англії, де багато хто сприймав сексуальність як щось «низинне» і «тварини», а невігластво щодо статевого виховання було поширене повсюдно, обговорення таких питань було справді радикальним.

У 1898 р. Пірсон був нагороджений Королівським товариством Дарвінською медаллю, від якої він відмовився, вважаючи, що нагороди “мають видаватися молодим людям, щоб заохотити їх”.

Флоренс Найтінгейл (12 травня 1820 – 13 серпня 1910)

Флоренс Найтінгейл (1820-1910) – сестра милосердя та громадська діячка Великобританії, у день народження якої ми сьогодні відзначаємо Міжнародний день медичної сестри.

Вона народилася у Флоренції в багатій аристократичній сім'ї, здобула блискучу освіту, знала шість мов. З юних років мріяла стати сестрою милосердя, в 1853 році здобула сестринську освіту в громаді сестер пастора Флендера в Кайзерверті і стала керуючою невеликою приватною лікарнею в Лондоні.

У жовтні 1854 року, в період Кримської війни, Флоренс разом із 38 помічницями вирушила до польових шпиталів до Криму. Організовуючи догляд за пораненими, вона послідовно проводила у життя принципи санітарії та гігієни. В результаті менш як за півроку смертність у лазаретах знизилася з 42 до 2,2%!

Поставивши собі завдання реформувати медичну службу в армії, Найтінгейл досягла того, щоб госпіталі були оснащені системами вентиляції та каналізації; лікарняний персонал обов'язково проходив необхідну підготовку. Було організовано військово-медичну школу, а серед солдатів і офіцерів велася роз'яснювальна робота про важливість профілактики хвороб.

Великі заслуги Флоренс Найтінгейл у медичній статистиці!

- Її 800-сторінкова книга «Нотатки про фактори, що впливають на здоров'я, ефективність та управління госпіталями британської армії» (1858) містила цілий розділ, присвячений статистиці та ілюстрований діаграмами.

- Найтінгейл стала новатором у використанні графічних зображень у статистиці. Вона винайшла кругові діаграми, які називала «півнячий гребінь» і використовувала для опису структури смертності. Багато її діаграм були включені до звіту комісії з проблем здоров'я в армії, завдяки якому було прийнято рішення про реформування армійської медицини.

- Розробила першу форму для збору статистики у шпиталях, яка є попередником сучасних звітних форм про діяльність стаціонару.

У 1859 р. була обрана членом Королівського статистичного товариства та згодом стала почесним членом Американської статистичної асоціації.

⠀Йоганн Карл Фрідріх Гаус (30 квітня 1777 – 23 лютого 1855)

30 квітня 1777 року у місті Брауншвейг народився великий німецький математик, механік, фізик, астроном, геодезист і статистик Йоганн Карл Фрідріх Гаусс.

Він вважається одним із найбільших математиків усіх часів, «королем математиків». Лауреат медалі Коплі (1838), іноземний член Шведської (1821) та Російської (1824) Академій наук, англійського Королівського товариства.

Вже три роки Карл умів читати і писати, навіть виправляв рахункові помилки батька. Згідно з легендою, шкільний вчитель математики, щоб зайняти дітей на довгий час, запропонував їм порахувати суму чисел від 1 до 100. Юний Гаусс зауважив, що попарні суми з протилежних кінців однакові: 1+100=101, 2+99=101 тощо. д., і миттєво отримав результат: 50 101 = 5050. До самої старості він звик більшу частину обчислень робити в думці.

Основними науковими заслугами Карла Гауса у статистиці є створення методу найменших квадратів, що лежить в основі регресійного аналізу.

Також він докладно досліджував поширений у природі нормальний закон розподілу, графік якого відтоді часто називають гауссіаною. Широку популярність отримало правило «трьох сигм» (правило Гаусса), що описує нормальний розподіл.

Лев Семенович Камінський (1889 – 1962)

У 75-ті роковини Перемоги у Великій Вітчизняної війнихочеться згадати і розповісти про чудового вченого, одного із засновників військово-медичної та санітарної статистики в СРСР - Лева Семеновича Камінського (1889-1962).

Він народився 27 травня 1889 року у Києві. Після закінчення з відзнакою 1918 р. медичного факультету Петроградського університету Камінський перебував у лавах Червоної Армії, з квітня 1919 до кінця 1920 р. обіймав посаду головного лікаря 136-го зведеного евакогоспіталя Південно-Східного фронту.

З 1922 р. Лев Семенович завідував санітарно-епідеміологічним відділом лікарсько-санітарної служби Північно-Західної. залізниці. У роки почалася наукова діяльність Камінського під керівництвом проф. С.А.Новосельського. У їх спільній фундаментальній праці «Втрати в минулих війнах» було проаналізовано статистичний матеріал про людські втрати у війнах різних армій світу з 1756 по 1918 р. У подальших роботах Камінським було розроблено та обґрунтовано нову, точнішу класифікацію військових втрат.

У монографії « Народне харчуванняі народне здоров'я» (1929) було детально розглянуто санітарно-гігієнічні аспекти впливу воєн на здоров'я населення, а також питання організації медичної допомоги населенню та армії у роки війни.

З 1935 по 1943 рік Лев Семенович очолює відділ санітарної (з 1942 р. – медичної) статистики Наркомздоров'я СРСР. У жовтні 1943 р. проф.Камінський стає начальником кафедри військово-медичної статистики Військово-медичної академії ім. С.М.Кірова, а з 1956 р. обіймає посаду професора кафедри статистики та обліку в Ленінградському державному університеті.

Лев Семенович виступав за широке впровадження кількісних методів у практику санітарної та медичної статистики. У 1959 р. під його авторством було видано навчальний посібник «Статистична обробка лабораторних та клінічних даних: застосування статистики в науковій та практичній роботі лікаря», який на довгі роки став одним із найкращих вітчизняних підручників з медичної статистики. У передмові Л.С.Камінський зазначає:

«... Здається важливим, щоб лікарі знали, як взятися за справу, вміли збирати і обробляти вірні цифри, придатні для порівнянь і зіставлень».

Критерії та методи

t-КРИТЕРІЙ СТЬЮДЕНТА ДЛЯ НЕЗАЛЕЖНИХ СУКУПНОСТЕЙ

t-критерій Стьюдента – загальна назва класу методів статистичної перевірки гіпотез (статистичних критеріїв), заснованих на розподілі Стьюдента. Найчастіші випадки застосування t-критерію пов'язані з перевіркою рівності середніх значень у двох вибірках.

Цей критерій був розроблений Вільямом Сілі Держсетом

2. Навіщо використовується t-критерій Стьюдента?

t-критерій Стьюдента використовується визначення статистичної значимості відмінностей середніх величин. Може застосовуватися як у випадках порівняння незалежних вибірок (наприклад, групи хворих на цукровий діабет та групи здорових), так і при порівнянні пов'язаних сукупностей (наприклад, середня частота пульсу у тих самих пацієнтів до і після прийому антиаритмічного препарату). У разі розраховується парний t-критерій Стьюдента

3. У яких випадках можна використовувати t-критерій Стьюдента?

Для застосування t-критерію Стьюдента необхідно, щоб вихідні дані мали нормальний розподіл. Також має значення рівність дисперсій (розподілу) порівнюваних груп (гомоскедастичність). При нерівних дисперсіях застосовується t-критерій модифікації Уэлча (Welch"s t).

За відсутності нормального розподілу порівнюваних вибірок замість t-критерію Стьюдента використовуються аналогічні методи непараметричної статистики, серед яких найбільш відомими є U-критерій Манна - Вітні.

4. Як розрахувати t-критерій Стьюдента?

Для порівняння середніх величин t-критерій Стьюдента розраховується за такою формулою:

де М 1- середня арифметична першої порівнюваної сукупності (групи), М 2- середня арифметична другої порівнюваної сукупності (групи), m 1- середня помилка першої середньої арифметичної, m 2- Середня помилка другої середньої арифметичної.

Отримане значення t-критерію Стьюдента необхідно правильно інтерпретувати. Для цього нам необхідно знати кількість досліджуваних у кожній групі (n1 і n2). Знаходимо кількість ступенів свободи fза наступною формулою:

F = (n 1 + n 2) - 2

Після цього визначаємо критичне значення t-критерію Стьюдента для необхідного рівня значущості (наприклад, p=0,05) та при цьому числі ступенів свободи fза таблицею (див. нижче).

- Якщо розраховане значення t-критерію Стьюдента дорівнює або більше критичного, знайденого за таблицею, робимо висновок про статистичну значущість відмінностей між величинами, що порівнюються.

- Якщо значення розрахованого t-критерію Стьюдента менше табличного, значить відмінності порівнюваних величин статистично не значущі.

Для вивчення ефективності нового препарату заліза було обрано дві групи пацієнтів із анемією. У першій групі пацієнти протягом двох тижнів отримували новий препарат, а у другій групі – отримували плацебо. Після цього було проведено вимірювання рівня гемоглобіну у периферичній крові. У першій групі середній рівень гемоглобіну становив 115,4±1,2 г/л, а в другій - 103,7±2,3 г/л (дані представлені у форматі M±m), порівнювані сукупності мають нормальний розподіл. У цьому чисельність першої групи становила 34, а другий - 40 пацієнтів. Необхідно зробити висновок про статистичну значущість отриманих відмінностей та ефективність нового препарату заліза.

Рішення:Для оцінки значущості відмінностей використовуємо t-критерій Стьюдента, що розраховується як різниця середніх значень, поділена на суму квадратів помилок:

Після виконання розрахунків значення t-критерію виявилося рівним 4,51. Знаходимо число ступенів свободи як (34 + 40) – 2 = 72. Порівнюємо отримане значення t-критерію Стьюдента 4,51 з критичним при р = 0,05 значенням, зазначеним у таблиці: 1,993. Так як розраховане значення критерію більше критичного, робимо висновок про те, що відмінності, що спостерігаються, статистично значущі (рівень значущості р<0,05).

ПАРНИЙ t-КРИТЕРІЙ СТЬЮДЕНТА

Парний t-критерій Стьюдента – одне з модифікацій методу Стьюдента, використовувана визначення статистичної значимості відмінностей парних (повторних) вимірів.

1. Історія розробки t-критерію

t-критерій був розроблений Вільямом Держсетомдля оцінки якості пива в компанії Гіннес. У зв'язку з зобов'язаннями перед компанією щодо нерозголошення комерційної таємниці, стаття Держсету вийшла 1908 року в журналі «Біометрика» під псевдонімом «Student» (Студент).

2. Навіщо використовується парний t-критерій Стьюдента?

Парний t-критерій Стьюдента використовується для порівняння двох залежних (парних) вибірок. Залежними є вимірювання, виконані в тих самих пацієнтів, але в різний час, наприклад, артеріальний тиск у хворих на гіпертонічну хворобу до і після прийому антигіпертензивного препарату. Нульова гіпотеза говорить про відсутність відмінностей між порівнюваними вибірками, альтернативна - наявність статистично значимих відмінностей.

3. У яких випадках можна використовувати парний t-критерій Стьюдента?

Основною умовою є залежність вибірок, тобто порівнювані значення мають бути отримані при повторних вимірах одного параметра в тих самих пацієнтів.

Як і для порівняння незалежних вибірок, для застосування парного t-критерію необхідно, щоб вихідні дані мали нормальний розподіл. При недотриманні цієї умови для порівняння середніх вибіркових повинні використовуватися методи непараметричної статистики, такі як G-критерій знаківабо Т-критерій Вілкоксону.

Парний t-критерій може використовуватися лише при порівнянні двовибірок. Якщо потрібно порівняти три і більше повторних вимірів, слід використовувати однофакторний дисперсійний аналіз (ANOVA) для повторних вимірів.

4. Як розрахувати парний t-критерій Стьюдента?

Парний t-критерій Стьюдента розраховується за такою формулою:

де М d- середня арифметична різниць показників, виміряних до та після, σ d- Середнє квадратичне відхилення різниць показників, n- Число досліджуваних.

5. Як інтерпретувати значення t-критерію Стьюдента?

Інтерпретація отриманого значення парного t-критерію Стьюдента не відрізняється від оцінки t-критерію для непов'язаних сукупностей. Насамперед, необхідно знайти число ступенів свободи fза наступною формулою:

F = n - 1

Після цього визначаємо критичне значення t-критерію Стьюдента для необхідного рівня значущості (наприклад, p<0,05) и при данном числе степеней свободы fза таблицею (див. нижче).

Порівнюємо критичне та розраховане значення критерію:

- Якщо розраховане значення парного t-критерію Стьюдента дорівнює або більше критичного, знайденого за таблицею, робимо висновок про статистичну значущість відмінностей між величинами, що порівнюються.

- Якщо значення розрахованого парного t-критерію Стьюдента менше табличного, значить відмінності порівнюваних величин статистично не значущі.

6. Приклад розрахунку t-критерію Стьюдента

Для оцінки ефективності нового гіпоглікемічного засобу були проведені вимірювання рівня глюкози в крові пацієнтів, які страждають на цукровий діабет, до та після прийому препарату. В результаті було отримано такі дані:

Рішення:

1. Розрахуємо різницю кожної пари значень (d):

| N пацієнта | Рівень глюкози у крові, ммоль/л | Різниця значень (d) | |

| до прийому препарату | після прийому препарату | ||

| 1 | 9.6 | 5.7 | 3.9 |

| 2 | 8.1 | 5.4 | 2.7 |

| 3 | 8.8 | 6.4 | 2.4 |

| 4 | 7.9 | 5.5 | 2.4 |

| 5 | 9.2 | 5.3 | 3.9 |

| 6 | 8.0 | 5.2 | 2.8 |

| 7 | 8.4 | 5.1 | 3.3 |

| 8 | 10.1 | 6.9 | 3.2 |

| 9 | 7.8 | 7.5 | 2.3 |

| 10 | 8.1 | 5.0 | 3.1 |

2. Знайдемо середню арифметичну різниці за формулою:

3. Знайдемо середнє квадратичне відхилення різниць від середньої за формулою:

4. Розрахуємо парний t-критерій Стьюдента:

5. Порівняємо отримане значення t-критерію Стьюдента 8.6 з табличним значенням, яке при числі ступенів свободи f 10 - 1 = 9 і рівні значимості p = 0.05 становить 2.262. Так як отримане значення більше критичного, робимо висновок про наявність статистично значимих відмінностей вмісту глюкози в крові до прийому і після прийому нового препарату.

U-КРИТЕРІЙ МАННА-УИТНІ

U-критерій Манна-Уітні – непараметричний статистичний критерій, що використовується для порівняння двох незалежних вибірок за рівнем будь-якої ознаки, виміряної кількісно. Метод заснований на визначенні того, чи досить мала зона значень, що перехрещуються, між двома варіаційними рядами (ранжованим рядом значень параметра в першій вибірці і таким же в другій вибірці). Чим менше значення критерію, тим швидше, що різницю між значеннями параметра у вибірках достовірні.

1. Історія розробки U-критерію

Даний метод виявлення відмінностей між вибірками було запропоновано у 1945 році американським хіміком та статистиком Френком Вілкоксоном.

У 1947 році він був суттєво перероблений та розширений математиками Х.Б. Манном(H.B. Mann) та Д.Р. Вітні(D.R. Whitney), за іменами яких сьогодні зазвичай називається.

2. Для чого використовується U-критерій Манна-Уітні?

U-критерій Манна-Уітні використовується для оцінки відмінностей між двома незалежними вибірками за рівнем будь-якої кількісної ознаки.

3. У яких випадках можна використовувати U-критерій Манна-Уітні?

U-критерій Манна-Уітні є непараметричним критерієм, тому, на відміну від t-критерію Стьюдента

U-критерій підходить для порівняння малих вибірок: у кожній із вибірок має бути не менше 3 значень ознаки. Допускається, щоб в одній вибірці було 2 значення, але в другій має бути не менше п'яти.

Умовою для застосування U-критерію Манна-Уітні є відсутність у порівнюваних групах значень ознаки, що збігаються (усі числа – різні) або дуже мале число таких збігів.

Аналогом U-критерію Манна-Уітні для порівняння трьох і більше груп є Критерій Краскела-Уолліса.

4. Як розрахувати U-критерій Манна-Уітні?

Спочатку з обох порівнюваних вибірок складається єдиний ранжований ряд, шляхом розставлення одиниць спостереження за ступенем зростання ознаки та присвоєння меншому значенню меншого рангу У разі рівних значень ознаки у кількох одиниць кожної з них надається середнє арифметичне послідовних значень рангів.

Наприклад, дві одиниці, які займають у єдиному ранжированном ряду 2 і 3 місце (ранг), мають однакові значення. Отже, кожній з них надається ранг рівний (3 + 2) / 2 = 2,5.

У складеному єдиному ранжованому ряду загальна кількість рангів вийде рівною:

N = n 1 + n 2

де n 1 - кількість елементів у першій вибірці, а n 2 - кількість елементів у другій вибірці.

Далі знову поділяємо єдиний ранжований ряд на два, що складаються відповідно до одиниць першої та другої вибірок, запам'ятовуючи при цьому значення рангів для кожної одиниці. Підраховуємо окремо суму рангів, що припали частку елементів першої вибірки, і окремо - частку елементів другої вибірки. Визначаємо велику із двох рангових сум (T x) відповідну вибірці з n x елементами.

Нарешті, знаходимо значення U-критерію Манна-Уітні за формулою:

5. Як інтерпретувати значення U-критерію Манна-Уітні?

Отримане значення U-критерію порівнюємо за таблицею для обраного рівня статистичної значущості (p=0.05 або p=0.01) з критичним значенням U при заданій чисельності порівнянних вибірок:

- Якщо отримане значення U меншетабличного або однойому, то визнається статистична значимість відмінностей між рівнями ознаки у аналізованих вибірках (приймається альтернативна гіпотеза). Достовірність відмінностей тим вища, що менше значення U.

- Якщо ж отримане значення U більшетабличного, приймається нульова гіпотеза.

КРИТЕРІЙ УІЛКОКСОНА

Критерій Вілкоксона для пов'язаних вибірок (також використовуються назви Т-критерій Вілкоксона, критерій Вілкоксона, критерій знакових рангів Вілкоксона, критерій суми рангів Вілкоксона) – непараметричний статистичний критерій, що використовується для порівняння двох пов'язаних (парних) вибірок за рівнем у безперервній чи порядковій шкалі.

Суть методу у тому, що зіставляються абсолютні величини вираженості зрушень у тому чи іншому напрямі. Для цього спочатку всі абсолютні величини зрушень ранжуються, а потім підсумовуються ранги. Якщо зрушення у той чи інший бік відбуваються випадково, то суми їх рангів виявляться приблизно рівні. Якщо ж інтенсивність зрушень в одну сторону більша, то сума рангів абсолютних значень зрушень у протилежний бік буде значно нижчою, ніж це могло бути при випадкових змінах.

1. Історія розробки критерію Вілкоксона для пов'язаних вибірок

Тест був уперше запропонований у 1945 році американським статистиком та хіміком Френком Вілкоксоном (1892-1965). У тій же науковій роботі автором було описано ще один критерій, який застосовується у разі порівняння незалежних вибірок.

2. Для чого використовується критерій Вілкоксона?

Т-критерій Вілкоксона використовується для оцінки відмінностей між двома рядами вимірювань, виконаних для однієї і тієї ж сукупності досліджуваних, але в різних умовах або в різний час. Даний тест здатний виявити спрямованість і вираженість змін - тобто чи є показники більш зрушеними в одному напрямку, ніж в іншому.

Класичним прикладом ситуації, в якій може застосовуватися Т-критерій Вілкоксону для пов'язаних сукупностей, є дослідження "до-після", коли порівнюються показники до та після лікування. Наприклад, щодо ефективності антигіпертензивного засобу порівнюється артеріальний тиск до прийому препарату і після прийому.

3. Умови та обмеження застосування Т-критерію Вілкоксону

- Критерій Вілкоксона є непараметричним критерієм, тому, на відміну від парного t-критерію Стьюдентане вимагає наявності нормального розподілу порівнюваних сукупностей.

- Число досліджуваних при використанні T-критерію Вілкоксону має бути не менше ніж 5.

- Досліджувана ознака може бути виміряна як у кількісній безперервній (артеріальний тиск, ЧСС, вміст лейкоцитів в 1 мл крові), так і в порядковій шкалі (число балів, ступінь тяжкості захворювання, ступінь обсіменіння мікроорганізмами).

- Цей критерій використовується лише у разі порівняння двох рядів вимірювань. Аналогом Т-критерію Вілкоксона для порівняння трьох і більше пов'язаних сукупностей є Критерій Фрідмана.

4. Як розрахувати Т-критерій Вілкоксона для пов'язаних вибірок?

- Обчислити різницю між значеннями парних вимірів кожного досліджуваного. Нульові зрушення далі не враховуються.

- Визначити, які з різниць є типовими, тобто відповідають переважному за частотою напряму зміни показника.

- Проранжувати різниці пар за їхніми абсолютними значеннями (тобто, без урахування знака), у порядку зростання. Найменшому абсолютному значенню різниці приписується менший ранг.

- Розрахувати суму рангів, що відповідають нетиповим зсувам.

Таким чином, Т-критерій Вілкоксону для пов'язаних вибірок розраховується за такою формулою:

де ΣRr - сума рангів, що відповідають нетиповим змінам показника.

5. Як інтерпретувати значення критерію Вілкоксона?

Отримане значення T-критерію Вілкоксона порівнюємо з критичним за таблицею для обраного рівня статистичної значущості ( p=0.05або p=0.01) при заданій чисельності зіставлюваних вибірок n:

- Якщо розрахункове (емпіричне) значення Темп. менше табличного Т кр. або одно йому, то визнається статистична значущість змін показника в типовий бік (приймається альтернативна гіпотеза). Достовірність відмінностей тим вища, що менше значення Т.

- Якщо Т емп. більше Т кр. , Приймається нульова гіпотеза про відсутність статистичної значущості змін показника

Приклад розрахунку критерію Вілкоксону для пов'язаних вибірок

Фармацевтичною компанією проводиться дослідження нового препарату із групи нестероїдних протизапальних засобів. Для цього відібрано групу з 10 добровольців, які страждають на ГРВІ з гіпертермією. У них була виміряна температура тіла до та через 30 хвилин після прийому нового препарату. Потрібно зробити висновок про значущість зниження температури тіла внаслідок прийому препарату.

- Вихідні дані оформлені у вигляді таблиці:

- Для розрахунку Т-критерію Вілкоксона розрахуємо різниці парних показників та проранжуємо їх абсолютні значення. При цьому нетипові ранги виділимо червоним шрифтом:

Як ми бачимо, типовим зрушеннямпоказника є його зниження, зазначене у 7 випадках з 10. В одному випадку (у пацієнта Єгорова) – температура після прийому препарату не змінилася, у зв'язку з чим цей випадок не використовувався у подальшому аналізі. У двох випадках (у пацієнтів Сидорова та Алексєєва) відзначався нетипове зрушеннятемператури у бік підвищення. Ранги, що відповідають нетиповому зрушенню, дорівнюють 1.5 і 3.N Прізвище t тіла до прийому препарату t тіла після прийому препарату Різниця показників, d |d| Ранг 1. Іванов 39.0 37.6 -1.4 1.4 7 2. Петров 39.5 38.7 -0.8 0.8 5 3. Сидорів 38.6 38.7 0.1 0.1 1.5 4. Попов 39.1 38.5 -0.6 0.6 4 5. Миколаїв 40.1 38.6 -1.5 1.5 8 6. Козлів 39.3 37.5 -1.8 1.8 9 7. Ігнатьєв 38.9 38.8 -0.1 0.1 1.5 8. Семенов 39.2 38.0 -1.2 1.2 6 9. Єгоров 39.8 39.8 0 — — 10. Алексєєв 38.8 39.3 0.5 0.5 3 - Розрахуємо Т-критерій Вілкоксона, який дорівнює сумі рангів, що відповідають нетиповому зрушенню показника:

T = ΣRr = 3 + 1.5 = 4.5

- Порівнюємо Т емп. з Т кр. , Що при рівні значимості p = 0.05 і n = 9 дорівнює 8. Отже, Т емп.

- Робимо висновок: зниження температури тіла у пацієнтів з ГРВІ в результаті прийому нового препарату є статистично значущим (р<0.05).

КРИТЕРІЙ ХІ-КВАДРАТ ПІРСОНА

Критерій χ 2 Пірсона – це непараметричний метод, який дозволяє оцінити значущість відмінностей між фактичною (виявленою в результаті дослідження) кількістю результатів або якісних характеристик вибірки, що потрапляють у кожну категорію, та теоретичною кількістю, яку можна очікувати в групах, що вивчаються, при справедливості нульової гіпотези. Висловлюючись простіше, метод дозволяє оцінити статистичну значущість відмінностей двох чи кількох відносних показників (частот, часток).

1. Історія розробки критерію χ 2

Критерій хі-квадрат для аналізу таблиць сполученості був розроблений та запропонований у 1900 році англійським математиком, статистиком, біологом та філософом, засновником математичної статистики та одним із основоположників біометрики Карлом Пірсоном(1857-1936).

2. Для чого використовується критерій 2 Пірсона?

Критерій хі-квадрат може застосовуватися під час аналізу таблиць сполученості, Що містять відомості про частоту результатів залежно від наявності фактора ризику Наприклад, чотирипільна таблиця сполученості виглядає так:

| Вихід є (1) | Виходу немає (0) | Усього | |

| Чинник ризику є (1) | A | B | A + B |

| Чинник ризику відсутній (0) | C | D | C+D |

| Усього | A + C | B + D | A+B+C+D |

Як заповнити таку таблицю поєднання? Розглянемо невеликий приклад.

Проводиться дослідження впливу куріння на ризик розвитку гіпертонії. Для цього було відібрано дві групи досліджуваних – до першої увійшли 70 осіб, які щодня викурюють не менше 1 пачки цигарок, у другу – 80 некурців такого ж віку. У першій групі у 40 осіб відзначався підвищений артеріальний тиск. У другій – артеріальна гіпертонія спостерігалася у 32 осіб. Відповідно, нормальний артеріальний тиск у групі курців був у 30 осіб (70 – 40 = 30) а у групі некурців – у 48 (80 – 32 = 48).

Заповнюємо вихідними даними чотирипольну таблицю сполученості:

В отриманій таблиці спряженості кожен рядок відповідає певній групі досліджуваних. Стовпці - показують кількість осіб із артеріальною гіпертонією чи з нормальним артеріальним тиском.

Завдання, яке ставиться перед дослідником: чи є статистично значущі відмінності між частотою осіб з артеріальним тиском серед курців та некурців? Відповісти на це питання можна, розрахувавши критерій хі-квадрат Пірсона і порівнявши значення, що вийшло, з критичним.

- Порівняні показники повинні бути виміряні в номінальній шкалі (наприклад, стать пацієнта - чоловіча або жіноча) або в порядковій (наприклад, ступінь артеріальної гіпертензії, що приймає значення від 0 до 3).

- Даний метод дозволяє проводити аналіз не тільки чотирипільних таблиць, коли і фактор, і результат є бінарними змінними, тобто мають лише два можливі значення (наприклад, чоловіча чи жіноча стать, наявність або відсутність певного захворювання в анамнезі...). Критерій хі-квадрат Пірсона може застосовуватися і у разі аналізу багатопольних таблиць, коли фактор та (або) результат приймають три і більше значень.

- Порівнювані групи повинні бути незалежними, тобто критерій хі-квадрат не повинен застосовуватися при порівнянні спостережень "до" після. У цих випадках проводиться тест Мак-Немара(при порівнянні двох пов'язаних сукупностей) або розраховується Q-критерій Кохрена(у разі порівняння трьох та більше груп).

- При аналізі чотирипольних таблиць очікувані значенняу кожному із осередків мають бути не менше 10. У тому випадку, якщо хоча б в одному осередку очікуване явище набуває значення від 5 до 9, критерій хі-квадрат повинен розраховуватися з поправкою Йейтса. Якщо хоча в одному осередку очікуване явище менше 5, то для аналізу повинен використовуватися точний критерій Фішера.

- У разі аналізу багатопільних таблиць очікуване число спостережень має приймати значення менше 5 більш ніж 20% осередків.

4. Як розрахувати критерій хі-квадрат Пірсона?

Для розрахунку критерію хі-квадрату необхідно:

Даний алгоритм застосуємо як для чотирипольних, так багатопольних таблиць.

5. Як інтерпретувати значення критерію хі-квадрат Пірсона?

У тому випадку, якщо отримане значення критерію χ 2 більше критичного, робимо висновок про наявність статистичного взаємозв'язку між фактором ризику, що вивчається, і результатом при відповідному рівні значущості.

6. Приклад розрахунку критерію хі-квадрат Пірсона

Визначимо статистичну значимість впливу фактора куріння на частоту випадків артеріальної гіпертонії за розглянутою вище таблицею:

- Розраховуємо очікувані значення для кожного осередку:

- Знаходимо значення критерію хі-квадрат Пірсона:

χ 2 = (40-33.6) 2 / 33.6 + (30-36.4) 2 / 36.4 + (32-38.4) 2 / 38.4 + (48-41.6) 2 / 41.6 = 4.396.

- Число ступенів свободи f = (2-1) * (2-1) = 1. Знаходимо по таблиці критичне значення критерію хі-квадрат Пірсона, яке при рівні значущості p = 0.05 та числі ступенів свободи 1 становить 3.841.

- Порівнюємо отримане значення критерію хі-квадрат із критичним: 4.396 > 3.841, отже залежність частоти випадків артеріальної гіпертонії від наявності куріння – статистично значуща. Рівень значимості цього взаємозв'язку відповідає p<0.05.

ТОЧНИЙ КРИТЕРІЙ ФІШЕРА

Точний критерій Фішера – це критерій, який використовується для порівняння двох відносних показників, що характеризують частоту певної ознаки, що має два значення. Вихідні дані до розрахунку точного критерію Фішера зазвичай групуються як чотирипольної таблиці.

1. Історія розробки критерію

Вперше критерій було запропоновано Рональдом Фішерому його книзі "Проектування експериментів". Це сталося 1935 року. Сам Фішер стверджував, що на цю думку наштовхнула його Муріель Брістоль. На початку 1920-х років Рональд, Муріель та Вільям Роуч перебували в Англії на дослідній сільськогосподарській станції. Муріель стверджувала, що може визначити, в якій послідовності наливали у її чашку чай та молоко. На той момент перевірити правильність її висловлювання неможливо.

Це дало поштовх ідеї Фішера про «нуль гіпотезу». Метою стала не спроба довести, що Муріель може визначити різницю між приготовленими по-різному чашками чаю. Вирішено було спростувати гіпотезу, що вибір жінка робить навмання. Було визначено, що нуль-гіпотезу не можна довести, ні обгрунтувати. Натомість її можна спростувати під час експериментів.

Було виготовлено 8 чашок. У перші чотири налито молоко спочатку, в інші чотири – чай. Чашки були схиблені. Брістоль запропонували випробувати чай на смак та розділити чашки за методом приготування чаю. В результаті мало вийти дві групи. Історія свідчить, що експеримент пройшов вдало.

Завдяки тесту Фішера ймовірність того, що Брістоль діє інтуїтивно, було зменшено до 0.01428. Тобто, правильно визначити чашку можна було в одному випадку з 70. Але все ж таки немає можливості звести до нуля шанси того, що мадам визначає випадково. Навіть якщо збільшувати кількість чашок.

Ця історія дала поштовх розвитку «нуль гіпотези». Тоді ж було запропоновано точний критерій Фішера, суть якого у переборі всіх можливих комбінацій залежної та незалежної змінних.

2. Навіщо використовується точний критерій Фішера?

Точний критерій Фішера переважно застосовується порівняння малих вибірок. Цьому є дві вагомі причини. По-перше, обчислення критерію є досить громіздкими і можуть займати багато часу або вимагати потужних обчислювальних ресурсів. По-друге, критерій досить точний (що відбилося навіть у його назві), що дозволяє його використовувати в дослідженнях з невеликою кількістю спостережень.

Особливе місце приділяється точному критерію Фішера в медицині. Це важливий метод обробки медичних даних, який знайшов своє застосування у багатьох наукових дослідженнях. Завдяки йому можна дослідити взаємозв'язок певних факторів і результатів, порівнювати частоту патологічних станів між двома групами досліджуваних і т.д.

3. У яких випадках можна використати точний критерій Фішера?

- Змінні змінні повинні бути виміряні в номінальній шкалі і мати тільки два значення, наприклад, артеріальний тиск в нормі або підвищено, результат сприятливий або несприятливий, післяопераційні ускладнення є чи ні.

- Точний критерій Фішера призначено для порівняння двох незалежних груп, розділених за факторною ознакою. Відповідно, фактор також повинен мати лише два можливі значення.

- Критерій підходить для порівняння дуже малих вибірок: точний критерій Фішера може застосовуватися для аналізу чотириповних таблиць у разі значень очікуваного явища менше 5, що є обмеженням застосування критерію хі-квадрат Пірсонанавіть з урахуванням поправки Йейтса.

- Точний критерій Фішера буває одностороннім та двостороннім. При односторонньому варіанті точно відомо, куди відхилиться один із показників. Наприклад, під час дослідження порівнюють, скільки пацієнтів одужало порівняно з групою контролю. Припускають, що терапія неспроможна погіршити стан пацієнтів, лише чи вилікувати, чи ні.

Двосторонній тест оцінює відмінності частот у двох напрямках. Тобто оцінюється ймовірність як більшої, і меншої частоти явища в експериментальної групі проти контрольної групою.

Аналогом точного критерію Фішера є Критерій хі-квадрат Пірсона, при цьому точний критерій Фішера має більш високу потужність, особливо при порівнянні малих вибірок, у зв'язку з чим у цьому випадку має перевагу.

4. Як розрахувати точний критерій Фішера?

Припустимо, вивчається залежність частоти народження дітей із вродженими вадами розвитку (ВВР) від куріння матері під час вагітності. Для цього вибрано дві групи вагітних жінок, одна з яких - експериментальна, що складається з 80 жінок, які курили в першому триместрі вагітності, а друга - група порівняння, що включає 90 жінок, які ведуть здоровий спосіб життя протягом усієї вагітності. Число випадків ВВР плода в експериментальній групі склало 10, у групі порівняння - 2.

Спочатку складаємо чотирипольну таблицю сполученості:

Точний критерій Фішера розраховується за такою формулою:

де N - загальна кількість досліджуваних у двох групах; ! - факторіал, що є добутком числа на послідовність чисел, кожне з яких менше попереднього на 1 (наприклад, 4! = 4 · 3 · 2 · 1)

В результаті обчислень знаходимо, що P = 0,0137.

5. Як інтерпретувати значення точного критерію Фішера?

Перевагою методу є відповідність отриманого критерію точного значення рівня значущості p. Тобто, отримане в прикладі значення 0,0137 і є рівень значущості відмінностей порівнюваних груп за частотою розвитку ВПР плода. Потрібно лише порівняти це число з критичним рівнем значущості, зазвичай прийнятим у медичних дослідженнях за 0,05.

- Якщо значення точного критерію Фішера більше критичного, приймається нульова гіпотеза і робиться висновок про відсутність статистично значимих відмінностей частоти результату залежно від фактору ризику.

- Якщо значення точного критерію Фішера менше критичного, приймається альтернативна гіпотеза і робиться висновок про наявність статистично значимих відмінностей частоти результату в залежності від впливу фактора ризику.

У нашому прикладі P< 0,05, в связи с чем делаем вывод о наличии прямой взаимосвязи курения и вероятности развития ВПР плода. Частота возникновения врожденной патологии у детей курящих женщин статистически значимо выше, чем у некурящих.

СТАВЛЕННЯ ШАНСІВ

Ставлення шансів – статистичний показник (російською його назву прийнято скорочувати як ЗОШ, а англійською - OR від "odds ratio"), один з основних способів описати в чисельному вираженні те, наскільки відсутність або наявність певного результату пов'язана з присутністю або відсутністю певного фактора у конкретній статистичній групі.

1. Історія розробки показника відношення шансів

Термін "шанс" прийшов з теорії азартних ігор, де за допомогою цього поняття означали відношення виграшних позицій до програшних. У науковій медичній літературі показник відношення шансів було вперше згадано у 1951 році в роботі Дж. Корнфілда. Згодом даним дослідником були опубліковані роботи, в яких наголошувалося на необхідності розрахунку 95% довірчого інтервалу для відношення шансів. (Cornfield, J. A Method for Estimating Comparative Rates from Clinical Data. Applications to Cancer of the Lung, Breast, and Cervix // Journal of the National Cancer Institute, 1951. - N.11. - P.1269-1275.)

2. Для чого використовується показник відношення шансів?

Ставлення шансів дозволяє оцінити зв'язок між певним результатом та фактором ризику.

Ставлення шансів дозволяє порівняти групи досліджуваних за частотою виявлення певного чинника ризику. Важливо, що результатом застосування відношення шансів є не лише визначення статистичної значущості зв'язку між фактором та результатом, а й її кількісна оцінка.

3. Умови та обмеження застосування відносин шансів

- Результативні та факторні показники мають бути виміряні у номінальній шкалі. Наприклад, результативна ознака - наявність або відсутність вродженої вади розвитку у плода, фактор, що вивчається, - куріння матері (курить або не курить).

- Даний метод дозволяє проводити аналіз тільки чотирипольних таблиць, коли і фактор, і результат є бінарними змінними, тобто мають лише два можливі значення (наприклад, стать - чоловіча або жіноча, артеріальна гіпертонія - наявність або відсутність, результат захворювання - з поліпшенням або без поліпшення ...).

- Порівнювані групи повинні бути незалежними, тобто показник відношення шансів не підходить для порівняння спостережень "до" після.

- Показник відношення шансів використовується в дослідженнях на кшталт "випадок-контроль" (наприклад, перша група - хворі на гіпертонічну хворобу, друга - відносно здорові люди). Для проспективних досліджень, коли групи формуються за ознакою наявності чи відсутності фактора ризику (наприклад, перша група – курці, друга група – некурці), може також розраховуватися відносний ризик.

4. Як розрахувати ставлення шансів?

Відношення шансів – це значення дробу, у чисельнику якого, є шанси певної події першої групи, а знаменнику шанси тієї самої події другої групи.

Шансомє відношення числа досліджуваних, що мають певну ознаку (вихід або фактор), до досліджуваних, у яких дана ознака відсутня.

Наприклад, було відібрано групу пацієнтів, прооперованих з приводу панкреонекрозу, кількість яких склала 100 осіб. Через 5 років з їхнього числа живими залишилося 80 осіб. Відповідно, шанс вижити становив 80 до 20, або 4.

Зручним способом є розрахунок відношення шансів зі зведенням даних до таблиці 2х2:

| Вихід є (1) | Виходу немає (0) | Усього | |

| Чинник ризику є (1) | A | B | A + B |

| Чинник ризику відсутній (0) | C | D | C+D |

| Усього | A + C | B + D | A+B+C+D |

Для даної таблиці відношення шансів розраховується за такою формулою:

Дуже важливо оцінити статистичну значущість виявленого зв'язку між результатом та фактором ризику. Пов'язано це з тим, що навіть при невисоких значеннях відношення шансів, близьких до одиниці, зв'язок може виявитися суттєвим і повинен враховуватися в статистичних висновках. І навпаки, при великих значеннях OR, показник виявляється статистично незначним, і, отже, виявленим зв'язком можна знехтувати.

Для оцінки значущості відношення шансів розраховуються межі 95% довірчого інтервалу (використовується абрревіатура 95% ДІ або 95% CI від англ. "confidence interval"). Формула для знаходження значення верхньої межі 95% CI:

Формула для знаходження значення нижньої межі 95% CI:

5. Як інтерпретувати значення шансів?

- Якщо відношення шансів перевищує 1, це означає, що шанси виявити фактор ризику більше у групі з наявністю результату. Тобто. фактор має прямий зв'язок із ймовірністю настання результату.

- Відношення шансів, що має значення менше 1, свідчить про те, що шанси виявити фактор ризику більший у другій групі. Тобто. фактор має зворотний зв'язок із ймовірністю настання результату.

- Щодо шансів, що дорівнює одиниці, шанси виявити фактор ризику в порівнюваних групах однакова. Відповідно, фактор не впливає на ймовірність результату.

Додатково у кожному випадку обов'язково оцінюється статистична значущість відношення шансів, виходячи зі значень 95% довірчого інтервалу.

- Якщо довірчий інтервал не включає 1, тобто. обидва значення меж або вище, або нижче 1, робиться висновок про статистичну значущість виявленого зв'язку між фактором і результатом при рівні значимості p<0,05.

- Якщо довірчий інтервал включає 1, тобто. його верхня межа більше 1, а нижня - менше 1, робиться висновок про відсутність статистичної значущості зв'язку між фактором та результатом при рівні значущості p>0,05.

- Величина довірчого інтервалу обернено пропорційна рівню значущості зв'язку чинника і результату, тобто. що менше 95% ДІ, то більш суттєвою є виявлена залежність.

6. Приклад розрахунку показника відношення шансів

Представимо дві групи: перша складалася з 200 жінок, у яких було діагностовано вроджену ваду розвитку плода (Вихід+). З них курили під час вагітності (Фактор+) – 50 осіб (А), були некурящими (Фактор-) - 150 осіб (С).

Другу групу склали 100 жінок без ознак ВПР плоду (Вихід -) серед яких курили під час вагітності (Фактор+) 10 осіб (B), не курили (Фактор-) - 90 осіб (D).

1. Складемо чотирипольну таблицю сполученості:

2. Розрахуємо значення відношення шансів:

OR = (A * D) / (B * C) = (50 * 90) / (150 * 10) = 3.

3. Знайдемо межі 95% CI. Значення нижньої межі, розрахованої за зазначеною вище формулою, склало 1,45, а верхньої - 6,21.

Таким чином, дослідження показало, що шанси зустріти жінку, що курить, серед пацієнток з діагностованим ВПР плода в 3 рази вище, ніж серед жінок без ознак ВПР плода. Залежність, що спостерігається, є статистично значущою, оскільки 95% CI не включає 1, значення його нижньої і верхньої меж більше 1.

ВІДНОСНИЙ РИЗИК

Ризик – це ймовірність появи певного результату, наприклад, хвороби чи травми. Ризик може набувати значення від 0 (ймовірність настання результату відсутня) до 1 (у всіх випадках очікується несприятливий результат). У медичній статистиці, як правило, вивчаються зміни ризику настання результату залежно від будь-якого фактора. Пацієнти умовно поділяються на 2 групи, однією з яких чинник впливає, іншу – немає.

Відносний ризик - це відношення частоти результатів серед досліджуваних, на яких впливав фактор, що вивчається, до частоти результатів серед досліджуваних, які не піддавалися впливу цього фактора. У науковій літературі часто використовують скорочену назву показника – ОР або RR (від англ. Relative risk).

1. Історія розробки показника відносного ризику

Розрахунок відносного ризику запозичений медичною статистикою з економіки. Правильна оцінка впливу політичних, економічних та соціальних факторів на затребуваність товару чи послуги може призвести до успіху, а недооцінка цих факторів – до фінансових невдач та банкрутства підприємства.

2. Навіщо використовується відносний ризик?

Відносний ризик використовується порівняння ймовірності результату залежно від наявності чинника ризику. Наприклад, в оцінці впливу куріння на частоту гіпертонічної хвороби, щодо залежності залежності частоти раку молочної залози від прийому оральних контрацептивів та інших. Відносний ризик - найважливіший показник у призначенні певних методів лікування чи проведенні досліджень із можливими побічними ефектами.

3. Умови та обмеження застосування відносного ризику

- Показники фактора та результату повинні бути виміряні в номінальній шкалі (наприклад, стать пацієнта - чоловіча або жіноча, артеріальна гіпертонія - є чи ні).

- Даний метод дозволяє проводити аналіз лише чотирипільних таблиць, коли і фактор, і результат є інарними змінними, тобто мають тільки два можливі значення (наприклад, вік молодше або старше 50 років, наявність або відсутність певного захворювання в анамнезі).

- Відносний ризик застосовується під час проспективних досліджень, коли досліджувані групи формуються за ознакою наявності чи відсутності фактора ризику. При дослідженнях за принципом "випадок-контроль" замість відносного ризику слід використовувати показник відносини шансів.

4. Як розрахувати відносний ризик?

Для розрахунку відносного ризику необхідно:

5. Як тлумачити значення відносного ризику?

Показник відносного ризику порівнюється з 1 для того, щоб визначити характер зв'язку фактора та результату:

- Якщо ОР дорівнює 1, можна дійти невтішного висновку, що досліджуваний чинник впливає ймовірність результату (відсутність зв'язку між чинником і результатом).

- При значеннях більше 1 робиться висновок у тому, що чинник підвищує частоту результатів (прямий зв'язок).

- При значеннях менше 1 - про зниження ймовірності результату при дії фактора ( Зворотній зв'язок).

Також обов'язково оцінюються значення меж 95% довірчого інтервалу. Якщо обидва значення - і нижньої, і верхньої межі - знаходяться по один бік від 1, або, іншими словами, довірчий інтервал не включає 1, робиться висновок про статистичній значущості виявленого зв'язку між фактором і результатом з ймовірністю помилки p<0,05.

Якщо нижня межа 95% ДІ менше 1, а верхня - більше, робиться висновок про відсутність статистичної значущості впливу фактора на частоту результату, незалежно від величини показника ОР (p>0,05).

6. Приклад розрахунку показника відносного ризику

У 1999 році в Оклахомі проводилися дослідження захворюваності чоловіків на виразку шлунка. Як фактор, що впливає, було обрано регулярне споживання фастфуду. У першій групі знаходилися 500 чоловіків, які постійно харчуються швидкою їжею, серед яких виразку шлунка діагностували у 96 осіб. У другу групу було відібрано 500 прихильників здорового харчування, серед яких виразка шлунка була діагностована у 31 випадку. Виходячи з отриманих даних, була побудована наступна таблиця сполученості:

КРИТЕРІЙ КОРРЕЛЯЦІЇ ПІРСОНА

Критерій кореляції Пірсона – це метод параметричної статистики, що дозволяє визначити наявність або відсутність лінійного зв'язку між двома кількісними показниками, а також оцінити її тісноту та статистичну значимість. Інакше кажучи, критерій кореляції Пірсона дозволяє визначити, чи змінюється (зростає чи зменшується) один показник у відповідь зміни інших? У статистичних розрахунках та висновках коефіцієнт кореляції зазвичай позначається як r xy або R xy.

1. Історія розробки критерію кореляції

Критерій кореляції Пірсона був розроблений командою британських учених на чолі з Карлом Пірсоном(1857-1936) у 90-х роках 19-го століття, для спрощення аналізу коварації двох випадкових величин. Крім Карла Пірсона, над критерієм кореляції Пірсона працювали також Френсіс Еджуорті Рафаель Велдон.

2. Навіщо використовується критерій кореляції Пірсона?

Критерій кореляції Пірсона дозволяє визначити, яка тіснота (або сила) кореляційного зв'язку між двома показниками, виміряними у кількісній шкалі. За допомогою додаткових розрахунків можна також визначити, наскільки статистично значущий виявлений зв'язок.

Наприклад, за допомогою критерію кореляції Пірсона можна відповісти на питання про наявність зв'язку між температурою тіла та вмістом лейкоцитів у крові при гострих респіраторних інфекціях, між зростанням та вагою пацієнта, між вмістом у питній воді фтору та захворюваністю населення на карієс.

3. Умови та обмеження застосування критерію хі-квадрат Пірсона

- Порівняні показники повинні бути виміряні в кількісній шкалі (наприклад, частота серцевих скорочень, температура тіла, вміст лейкоцитів в 1 мл крові, артеріальний систолічний тиск).

- За допомогою критерію кореляції Пірсона можна визначити лише наявність та силу лінійного взаємозв'язку між величинами. Інші характеристики зв'язку, у тому числі напрямок (прямий або зворотний), характер змін (прямолінійний або криволінійний), а також наявність залежності однієї змінної від іншої - визначаються за допомогою регресійного аналізу.

- Кількість зіставлюваних величин має дорівнювати двом. У разі аналізу взаємозв'язку трьох і більше параметрів слід скористатися методом факторного аналізу.

- Критерій кореляції Пірсона є параметричним, у зв'язку з чим умовою його застосування служить нормальний розподіл кожної зі змінних, що зіставляються. У разі потреби кореляційного аналізу показників, розподіл яких відрізняється від нормального, у тому числі виміряних у порядковій шкалі, слід використовувати коефіцієнт рангової кореляції Спірмена.

- Слід чітко розрізняти поняття залежності та кореляції. Залежність величин обумовлює наявність кореляційного зв'язку з-поміж них, але з навпаки.

Наприклад, зростання дитини залежить від її віку, тобто чим старша дитина, тим вона вища. Якщо ми візьмемо двох дітей різного віку, то з високою ймовірністю зростання старшої дитини буде більшим, ніж у молодшого. Дане явище і називається залежністю, що передбачає причинно-наслідковий зв'язок між показниками. Зрозуміло, між ними є і кореляційний зв'язок, що означає, що зміни одного показника супроводжуються змінами іншого показника.

В іншій ситуації розглянемо зв'язок зростання дитини та частоти серцевих скорочень (ЧСС). Як відомо, обидві ці величини безпосередньо залежать від віку, тому в більшості випадків діти більшого зростання (а значить і старшого віку) матимуть менші значення ЧСС. Тобто кореляційний зв'язок спостерігатиметься і може мати досить високу тісноту. Однак, якщо ми візьмемо дітей одного віку, але різного зростання, то, швидше за все, ЧСС у них відрізнятиметься несуттєво, у зв'язку з чим можна зробити висновок про незалежність ЧСС від зростання.

Наведений приклад показує, наскільки важливо розрізняти фундаментальні у статистиці поняття зв'язку та залежності показників для побудови вірних висновків.

4. Як розрахувати коефіцієнт кореляції Пірсона?

Розрахунок коефіцієнта кореляції Пірсона здійснюється за такою формулою:

5. Як інтерпретувати значення коефіцієнта кореляції Пірсона?

Значення коефіцієнта кореляції Пірсона інтерпретуються з його абсолютних значень. Можливі значення коефіцієнта кореляції варіюють від 0 до ±1. Чим більше абсолютне значення r xy – тим вища тіснота зв'язку між двома величинами. r xy = 0 говорить про повну відсутність зв'язку. r xy = 1 – свідчить про наявність абсолютного (функціонального) зв'язку. Якщо значення критерію кореляції Пірсона виявилося більшим за 1 або менше -1 – у розрахунках допущена помилка.

Для оцінки тісноти або сили кореляційного зв'язку зазвичай використовують загальноприйняті критерії, згідно з якими абсолютні значення r xy< 0.3 свидетельствуют о слабкоюзв'язку, значення r xy від 0.3 до 0.7 - про зв'язок середньоїтісноти, значення r xy > 0.7 - о сильноюзв'язку.

Точнішу оцінку сили кореляційного зв'язку можна отримати, якщо скористатися таблицею Чеддока:

Оцінка статистичної значущості коефіцієнта кореляції r xy здійснюється за допомогою t-критерію, що розраховується за такою формулою:

Отримане значення t r порівнюється з критичним значенням за певного рівня значущості та числа ступенів свободи n-2. Якщо t r перевищує t крит, робиться висновок про статистичній значущості виявленого кореляційного зв'язку.

6. Приклад розрахунку коефіцієнта кореляції Пірсона

Метою дослідження було виявлення, визначення тісноти та статистичної значущості кореляційного зв'язку між двома кількісними показниками: рівнем тестостерону в крові (X) та відсотком м'язової маси в тілі (Y). Вихідні дані для вибірки, що складається з 5 досліджуваних (n = 5), зведені в таблиці:

КРИТЕРІЙ СПІРМЕНА

p align="justify"> Коефіцієнт рангової кореляції Спірмена - це непараметричний метод, який використовується з метою статистичного вивчення зв'язку між явищами. У цьому випадку визначається фактичний ступінь паралелізму між двома кількісними рядами ознак, що вивчаються, і дається оцінка тісноти встановленого зв'язку за допомогою кількісно вираженого коефіцієнта.

1. Історія розробки коефіцієнта рангової кореляції

Цей критерій було розроблено та запропоновано для проведення кореляційного аналізу у 1904 році. Чарльзом Едвардом Спірменом, англійським психологом, професором Лондонського та Честерфілдського університетів.

2. Для чого використовується коефіцієнт Спірмена?

Коефіцієнт рангової кореляції Спірмена використовується для виявлення та оцінки тісноти зв'язку між двома рядами кількісних показників, що зіставляються. У тому випадку, якщо ранги показників, упорядкованих за ступенем зростання або спадання, в більшості випадків збігаються (більшому значенню одного показника відповідає більше значення іншого показника - наприклад, при зіставленні зростання пацієнта та його маси тіла), робиться висновок про наявність прямийкореляційного зв'язку. Якщо ранги показників мають протилежну спрямованість (великому значенню одного показника відповідає менше значення іншого - наприклад, при зіставленні віку та частоти серцевих скорочень), то говорять про зворотнійзв'язок між показниками.

- Коефіцієнт кореляції Спірмена має такі властивості:

- Коефіцієнт кореляції може набувати значення мінус одиниці до одиниці, причому при rs=1 має місце строго прямий зв'язок, а при rs= -1 – строго зворотний зв'язок.

- Якщо коефіцієнт кореляції негативний, має місце зворотний зв'язок, якщо позитивний, то – прямий зв'язок.

- Якщо коефіцієнт кореляції дорівнює нулю, зв'язок між величинами практично відсутня.

- Чим ближче модуль коефіцієнта кореляції до одиниці, тим сильнішим є зв'язок між вимірюваними величинами.

3. У яких випадках можна використати коефіцієнт Спірмена?

У зв'язку з тим, що коефіцієнт є методом непараметричного аналізу, перевірка на нормальність розподілу не потрібна.

Порівняні показники можуть бути виміряні як у безперервній шкалі (наприклад, кількість еритроцитів в 1 мкл крові), так і в порядковій (наприклад, оцінки оцінки від 1 до 5).

Ефективність та якість оцінки методом Спірмена знижується, якщо різниця між різними значеннямиякий-небудь із вимірюваних величин досить велика. Не рекомендується використовувати коефіцієнт Спірмена, якщо є нерівномірний розподіл значень вимірюваної величини.

4. Як розрахувати коефіцієнт Спірмена?

Розрахунок коефіцієнта рангової кореляції Спірмена включає такі етапи:

5. Як інтерпретувати значення коефіцієнта Спірмена?

При використанні коефіцієнта рангової кореляції умовно оцінюють тісноту зв'язку між ознаками, вважаючи значення коефіцієнта менше 0,3 ознакою слабкої тісноти зв'язку; значення більше 0,3, але менше 0,7 - ознакою помірної тісноти зв'язку, а значення 0,7 і більше ознакою високої тісноти зв'язку.

Також для оцінки тісноти зв'язку може використовуватись шкала Чеддока.

Статистична значимість отриманого коефіцієнта оцінюється з допомогою t-критерію Стьюдента. Якщо розраховане значення t-критерію менше табличного при заданому числі ступенів свободи, статистична значимість взаємозв'язку, що спостерігається - відсутня. Якщо більше, то кореляційний зв'язок вважається статистично значущим.

МЕТОД КОЛМОГОРОВА-СМИРНОВА

Критерій Колмогорова-Смирнова – непараметричний критерій згоди, у класичному розумінні призначений перевірки простих гіпотез про належність аналізованої вибірки деякому відомому закону розподілу. Найбільш відоме застосування даного критерію для перевірки досліджуваних сукупностей нормальності розподілу.

1. Історія розробки критерію Колмогорова-Смирнова

Критерій Колмогорова-Смирнова був розроблений радянськими математиками Андрієм Миколайовичем Колмогоровимі Миколою Васильовичем Смирновим.

Колмогоров А.М. (1903-1987) – Герой Соціалістичної Праці, професор Московського державного університетуАкадемік АН СРСР - найбільший математик XX століття, є одним з основоположників сучасної теорії ймовірності.

Смирнов Н.В. (1900-1966) - член-кореспондент АН СРСР, один із творців непараметричних методів математичної статистики та теорії граничних розподілів порядкових статистик.

Згодом критерій згоди Колмогорова-Смирнова був доопрацьований з метою застосування для перевірки сукупностей на нормальність розподілу американським статистиком, професором Університету Джорджа Вашингтона Х'юбертом Ліллієфорсом(Hubert Whitman Lilliefors, 1928-2008). Професор Лілієфорс був одним із піонерів застосування комп'ютерної технікиу статистичних розрахунках.

Х'юберт Ліллієфорс2. Навіщо використовується критерій Колмогорова-Смирнова?

Цей критерій дозволяє оцінити суттєвість відмінностей між розподілами двох вибірок, у тому числі можливе його застосування для оцінки відповідності розподілу досліджуваної вибірки закону нормального розподілу.

3. У яких випадках можна використати критерій Колмогорова-Смирнова?

Критерій Колмогорова-Смирнова призначений для перевірки нормальності розподілу сукупностей кількісних даних.

Для більшої достовірності отриманих даних обсяги аналізованих вибірок має бути досить великими: n ≥ 50. При розмірах оцінюваної сукупності від 25 до 50 елементів доцільно застосування поправки Більшова.

4. Як розрахувати критерій Колмогорова-Смирнова?

Критерій Колмогорова-Смирнова розраховується за допомогою спеціальних статистичних програм. В основі лежить статистика виду:

де sup S- точна верхня грань множини S, F n- функція розподілу досліджуваної сукупності, F(x)- функція нормального розподілу

Значення ймовірності, що виводяться, засновані на припущенні, що середнє і стандартне відхилення нормального розподілу відомі апріорі і не оцінюються з даних.

Однак на практиці зазвичай параметри обчислюються безпосередньо з даних. У цьому випадку критерій нормальності включає складну гіпотезу ("наскільки ймовірно отримати D статистику даної або більшої значущості, яка залежить від середнього та стандартного відхилення, обчислених з даних"), і наводяться ймовірності Ліллієфорса (Lilliefors, 1967).

5. Як інтерпретувати значення критерію Колмогорова-Смирнова?

Якщо D статистика Колмогорова-Смирнова значуща (p<0,05), то гипотеза о том, что соответствующее распределение нормально, должна быть отвергнута.

Метод угруповань дозволяє також виміряти варіацію(мінливість, коливання) ознак. При відносно малому числі одиниць сукупності варіація вимірюється з урахуванням ранжованого низки одиниць, що утворюють сукупність. Ряд називається ранжованим,якщо одиниці розташовані за зростанням (зменшенням) ознаки.

Проте ранжовані ряди досить малопоказові тоді, коли потрібна порівняльна характеристика варіації. Крім того, в багатьох випадках доводиться мати справу зі статистичними сукупностями, що складаються з великої кількості одиниць, які важко уявити у вигляді конкретного ряду. У зв'язку з цим для первинного загального ознайомлення зі статистичними даними і особливо полегшення вивчення варіації ознак досліджувані явища і процеси зазвичай об'єднують у групи, а результати угруповання оформляють як групових таблиць.

Якщо груповий таблиці є лише дві графи - групи за виділеним ознакою (варіанти) і чисельності груп (частоти чи частоти), вона називається поряд розподілу.

Ряд розподілу -найпростіший різновид структурного угруповання за однією ознакою, відображена в груповій таблиці з двома графами, в яких містяться варіанти та частоти ознаки. У багатьох випадках з такого структурного угруповання, тобто. із складання рядів розподілу, починається вивчення вихідного статистичного матеріалу.

Структурне угруповання у вигляді ряду розподілу може бути перетворено на справжнє структурне угруповання, якщо виділені групи будуть охарактеризовані не тільки частотами, а й іншими статистичними показниками. Головне призначення рядів розподілу – вивчення варіації ознак. Теорію розподілу докладно розробляє математична статистика.

Ряди розподілу ділять на атрибутивні(угруповання за атрибутивними ознаками, наприклад розподіл населення за статтю, національністю, сімейним станом тощо) і варіаційні(Угруповання за кількісними ознаками).

Варіаційний рядявляє собою групову таблицю, яка містить дві графи: угруповання одиниць за однією кількісною ознакою та чисельність одиниць у кожній групі. Інтервали у варіаційному ряду утворюються зазвичай рівні та закриті. Варіаційним рядом є наступне угруповання населення Росії за величиною середньодушових грошових доходів (табл. 3.10).

Таблиця 3.10

Розподіл чисельності населення Росії за величиною середньодушових доходів у 2004-2009 роках.

|

Групи населення за величиною середньодушових грошових доходів, руб./міс. |

Чисельність населення групи, в % до результату |

|||||

|

8 000,1-10 000,0 |

||||||

|

10 000,1-15 000,0 |

||||||

|

15 000,1-25 000,0 |

||||||

|

Понад 25 000,0 |

||||||

|

Все населення |

||||||

Варіаційні ряди у свою чергу поділяються на дискретні та інтервальні. Дискретні варіаційні рядипоєднують варіанти дискретних ознак, що змінюються у вузьких межах. Прикладом дискретного варіаційного ряду може бути розподіл російських сімей за кількістю наявних дітей.

Інтервальніваріаційні ряди поєднують варіанти або безперервних ознак або змінюються в широких межах дискретних ознак. Інтервальним є варіаційний ряд розподілу населення Росії за величиною середньодушових грошових доходів.

Дискретні варіаційні ряди практично застосовуються не надто часто. Тим часом складання їх нескладно, оскільки склад груп визначається конкретними варіантами, якими реально мають досліджувані групувальні ознаки.

Найбільш поширені інтервальні варіаційні ряди. При їх складанні виникає складне питання про кількість груп, а також величину інтервалів, які повинні бути встановлені.

Принципи вирішення цього питання викладено у розділі про методологію побудови статистичних угруповань (див. параграф 3.3).

Варіаційні ряди являють собою засіб згортання або стиснення різноманітної інформації в компактну форму, за ними можна скласти досить чітке судження про характер варіації, вивчити відмінності ознак явищ, що входять досліджувану сукупність. Але найважливіше значення варіаційних рядів у тому, що у основі обчислюються особливі узагальнюючі характеристики варіації (див. главу 7).

При обробці великих масивів інформації, що особливо актуально під час проведення сучасних наукових розробок, перед дослідником стоїть серйозне завдання правильного угруповання вихідних даних. Якщо дані мають дискретний характер, то проблем, як ми бачили, не виникає – необхідно просто підрахувати частоту кожної ознаки. Якщо ж досліджувана ознака має безперервнийхарактер (що має більшого поширення практично), то вибір оптимального числа інтервалів угруповання ознаки зовсім на тривіальної завданням.

Для угруповання безперервних випадкових величин весь варіаційний розмах ознаки розбивають на кілька інтервалів до.

Згрупованим інтервальним (безперервним) варіаційним рядомназивають ранжировані за значенням ознаки інтервали (), де вказані разом з відповідними частотами () числа спостережень, що потрапили в г-й інтервал, або відносними частотами ():

|

Інтервали значень ознаки |

||||||

|

Частота mi |